Bei der Traffic-Arbitrage ist kreative Arbeit das wertvollste Gut. Sein Potenzial ist jedoch auf eine Sprache und ein GEO beschränkt. Im Jahr 2026 haben KI-Tools für Übersetzungen und Voice-Over diese Hürde abgerissen: Ein Video kann ohne professionelle Sprecher und Übersetzer innerhalb von Stunden in 5–10 Sprachen adaptiert werden. ElevenLabs, HeyGen, Rask AI, Dubverse – für Sprachausgabe. DeepL, Claude, GPT-4 – zum Übersetzen von Skripten. Sync Labs – für die Lippensynchronisation. Aber die Multi-Geo-Anpassung birgt Fallstricke, die auf den ersten Blick nicht sichtbar sind: Der falsche Akzent kann Conversions zerstören, kulturelle Inkonsistenzen können Negativität hervorrufen und die gleiche duplizierte Version auf Dutzenden von Konten kann das gesamte Raster ruinieren. Dieser Artikel enthält eine vollständige Analyse der Tools, einen schrittweisen Arbeitsablauf vom Original bis zum Upload, echte Preise und Fehler, die Budgets verschwenden.

Warum braucht ein Affiliate-Vermarkter Multigeo: Ökonomie der Lokalisierung

Die Logik ist einfach: Ein funktionierendes Motiv ist eine getestete Hypothese. Sie haben bereits Zeit und Geld in Tests investiert und eine Kombination gefunden, die umsetzt. Nun stellt sich die Frage, wie man das Beste daraus macht. Der naheliegendste Weg zur Skalierung besteht darin, die Anzahl der Konten in einem GEO zu erhöhen. Aber es gibt eine Obergrenze: Das Publikum ist begrenzt, die Konkurrenz wächst, Kreative brennen aus. Multigeo entfernt diese Obergrenze.

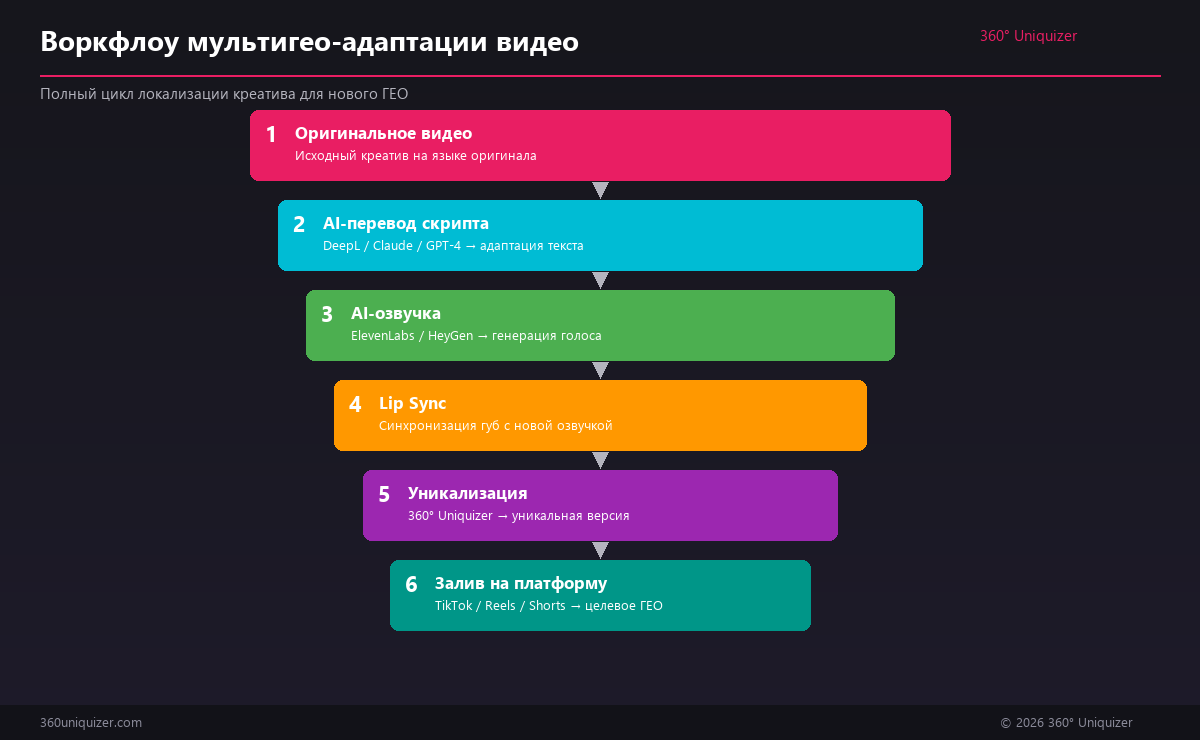

Vollständiger Zyklus der KI-Kreativlokalisierung für eine neue GEO

Ein ins Spanische adaptiertes Video ist der Zugang zu den Märkten Spanien, Mexiko, Argentinien und Kolumbien. Auf Portugiesisch – Brasilien, Portugal. Auf Deutsch - Deutschland, Österreich, Schweiz. Türkisch, thailändisch und indonesisch sind riesige Tier-2-Märkte mit geringer Konkurrenz. Aus einem Creative werden 5–10 separate Kampagnen mit separaten Kontorastern.

Tier 1 vs. Tier 2: Anpassungsmöglichkeiten

Stufe 1 (EN, DE, FR, ES, IT, JP) – hohe CPA-Zahlungen, aber harter Wettbewerb und teurer Traffic. Die Lokalisierung in diese Sprachen ist gerechtfertigt, wenn das Angebot 30 $ oder mehr pro Konvertierung kostet. Die Qualität der Übersetzung und Sprachausgabe muss einwandfrei sein – das Publikum reagiert empfindlich auf „Maschinen“-Sound.

Stufe 2 (PT-BR, TR, TH, ID, PL, RO, HI, AR) – Die Auszahlungen sind niedriger (5–15 $ pro Conversion), aber die Konkurrenz ist minimal und das Traffic-Volumen ist riesig. Brasilien – 220 Millionen Einwohner, Indonesien – 280 Millionen, Indien – 1,4 Milliarden. Selbst bei bescheidenen Zahlungen gleicht das Volumen alles aus. Die Qualitätsanforderungen an die Sprachausgabe sind geringer – das Publikum ist an synchronisierte Inhalte gewöhnt.

Optimale Strategie: Beginnen Sie mit Sprachen der Stufe 2, wo die Konkurrenz geringer ist und Lokalisierungsfehler weniger kritisch sind. Üben Sie Ihren Arbeitsablauf und skalieren Sie dann mit höherwertiger Anpassung auf Stufe 1. Zuvor kostete die Lokalisierung eines Videos in fünf Sprachen 500–1.500 US-Dollar (Übersetzer + Ansager) und dauerte eine Woche. Jetzt – 10–50 $ und ein paar Stunden. KI hat Multigeo für jeden Affiliate-Vermarkter zugänglich gemacht.

KI-Übersetzung von Skripten und Untertiteln: DeepL, Claude, GPT-4

Übersetzung ist die erste Stufe der Lokalisierung. Bevor Sie ein Video in eine andere Sprache überspielen, müssen Sie das Skript übersetzen. Und hier ist es von entscheidender Bedeutung, nicht nur die Worte zu übersetzen, sondern die Marketingbotschaft an die Kultur des Ziel-GEO anzupassen. Ein normaler Übersetzer (oder Google Translate) kann damit nicht umgehen – Sie benötigen Tools, die den Kontext verstehen.

DeepL

Der beste maschinelle Übersetzer für europäische Sprachen. DeepL erstellt stets Übersetzungen, die natürlich klingen – insbesondere in Deutsch, Französisch, Spanisch, Polnisch und Portugiesisch. Unterstützt formelles und informelles Register – entscheidend für Marketingtexte.

Stärken: Europäische Sprachen, Tongenauigkeit, API-Integration für Stapelverarbeitung. Kostenloser Plan – 500.000 Zeichen/Monat. Pro – 8,74 $/Monat.

Einschränkungen: schwächer in asiatischen Sprachen (Thai, Indonesisch, Hindi). Passt Slang und CTA nicht an einen bestimmten Markt an – es wird wörtlich übersetzt. Versteht die Schiedsterminologie nicht.

Claude

Das leistungsstärkste Tool zur Anpassung von Marketingtexten. Claude versteht den Kontext auf einer tiefen Ebene: Wenn Sie erklären, dass es sich bei dem Text um ein Drehbuch für einen Werbespot in der Nutra-Vertikalen für ein brasilianisches Publikum handelt, passt er nicht nur die Sprache an, sondern auch den Vortragsstil, die Gesprächswendungen und den CTA.

Stärken: kontextbezogene Anpassung, Umgang mit Slang, die Fähigkeit, durch eine Systemaufforderung den Ton anzugeben und die Zielgruppe anzusprechen. Funktioniert hervorragend mit der CTA-Lokalisierung: „Jetzt kaufen“ wird nicht zu einer wörtlichen Übersetzung, sondern zu einer Konvertierungsphrase für eine bestimmte GEO.

Einschränkungen: ist für große Texte teurer als DeepL. Erfordert eine kompetente Eingabeaufforderung – ohne Kontext bedeutet es „zu literarisch“. Weigert sich möglicherweise, aggressive Marketingsprache zu übersetzen.

GPT-4

Ein universelles Tool mit der umfassendsten Sprachabdeckung. GPT-4 kommt sogar mit seltenen Sprachen (Tagalog, Vietnamesisch, Suaheli) zurecht, bei denen DeepL und Claude schwächer sind. Über die Systemaufforderung können Sie genaue Parameter festlegen: „Als gesprochenen Text für ein TikTok-Video übersetzen, Zielgruppe: Frauen 25–35, Mexiko, informeller Ton.“

Stärken: maximale Sprachabdeckung, flexible Systemansagen, API für Automatisierung. Kommt gut mit der Anpassung numerischer Daten (Währung, Maßeinheiten) an GEO zurecht.

Einschränkungen: Die Übersetzungsqualität in europäische Sprachen ist schlechter als bei DeepL. Manchmal „halluziniert“ es – es fügt Informationen hinzu, die nicht im Original enthalten waren. Erfordert Muttersprachlerüberprüfung für Tier 1 GEO.

So wählen Sie ein Übersetzungstool aus

- Europäische Sprachen (DE, FR, ES, IT, PL, PT): DeepL für grundlegende Übersetzungen → Claude für die Anpassung von CTAs und Marketingsprache

- Asiatische und seltene Sprachen (TH, ID, HI, AR, VI): GPT-4 mit detaillierter Systemaufforderung

- Untertitel (SRT/VTT): DeepL über API – schnell, günstig, genau genug für Untertitel

- Marketingskripte und CTA: Claude mit einer Aufforderung zur Beschreibung der Branche, der Zielgruppe und der GEO

Tipp: Übersetzen Sie den CTA immer getrennt vom Haupttext. „Erfahren Sie mehr“, „Jetzt kaufen“, „Erhalten Sie einen Rabatt“ – diese Sätze sollten für einen bestimmten Markt typisch klingen und nicht wie eine Kopie von Russisch oder Englisch. Investieren Sie 5 Minuten in die schnelle Entwicklung des CTA – es wird sich in der Konvertierung auszahlen.

AI-Video-Voiceover: ElevenLabs, HeyGen, Rask AI, Dubverse

Das Drehbuch wurde übersetzt – jetzt müssen wir es vertonen. Im Jahr 2026 hat die KI-Sprachausgabe ein Niveau erreicht, bei dem der durchschnittliche Zuschauer die Stimme eines neuronalen Netzwerks nicht mehr von der eines Live-Sprechers unterscheiden kann. Aber die Werkzeuge sind für unterschiedliche Aufgaben konzipiert – und die Wahl des falschen Werkzeugs kann das Budget verschlingen oder die Qualität beeinträchtigen.

ElevenLabs

Marktführer für Sprachqualität. Bei ElevenLabs geht es um Klang: Intonation, Pausen, emotionale Färbung – alles kommt der Live-Sprache so nahe wie möglich. Die Hauptfunktion ist das Klonen von Stimmen: Laden Sie 30 Sekunden Audio mit einer Stimme hoch und das neuronale Netzwerk reproduziert diese Stimme in einer von über 30 Sprachen.

Funktionen: Text-to-Speech in über 30 Sprachen, Stimmklonen, Emotions- und Geschwindigkeitskontrolle, Stapelverarbeitungs-API. Unterstützt SSML-Markup zur Feinabstimmung von Pausen und Akzenten.

Preise: Starter – 5 $/Monat (30 Minuten Audio). Creator – 22 $/Monat (100 Minuten). Pro – 99 $/Monat (500 Minuten). Für Arbitragevolumen ist Creator oder Pro optimal. Die Kosten pro Minute betragen je nach Tarif 0,07–0,22 $.

Verwendungszweck: „Talking Head“, Voice-Over, jedes Format, bei dem die Sprachqualität entscheidend ist. Ideal für Dating und Dating, wo sich das Vertrauen in die Stimme direkt auf die Konvertierung auswirkt.

HeyGen

Kombinieren Sie: Übersetzung + Sprachausgabe + Lippensynchronisation in einem Instrument. Laden Sie ein Video hoch – HeyGen transkribiert Gesprochenes automatisch, übersetzt es in die ausgewählte Sprache, vertont es mit einer neuronalen Netzwerkstimme und synchronisiert Lippenbewegungen. Der gesamte Vorgang ist mit einem Klick erledigt.

Funktionen: End-to-End-Videoübersetzung, integrierte Lippensynchronisation, über 40 Sprachen, Stimmklonen, KI-Avatar-Generierung. Unterstützt das Laden eines fertigen Skripts – wenn Sie es über Claude oder DeepL übersetzt haben, können Sie Ihre eigene Übersetzung anstelle der automatischen verwenden.

Preise: Ersteller – 24 $/Monat (15 Minuten Video). Geschäftlich – 60 $/Monat (30 Minuten). Unternehmen – individuell. Die Kosten pro Videominute betragen 1,6–2,0 US-Dollar. Teurer als reines Voice-Over über ElevenLabs, aber inklusive Lippensynchronisation.

Verwendungszweck: Talking-Head-Videos, bei denen eine Lippensynchronisation erforderlich ist. Ein Tool statt einer Dreierkette – Zeitersparnis bei umfangreichen Lokalisierungen.

Rask AI

Das beste Tool für die Stream-Verarbeitung. Rask AI ist auf Volumen ausgelegt: Dutzende Videos hochladen, Zielsprachen auswählen – das System verarbeitet alles im Batch-Modus. Die Qualität der Sprachausgabe ist schlechter als bei ElevenLabs, aber für Tier 2 GEO und kurze Videos (15–60 Sekunden) ist sie mehr als ausreichend.

Funktionen: automatische Transkription, Übersetzung in über 130 Sprachen, KI-Sprachausgabe mit Sprachauswahl, automatische Untertitel, einfache Lippensynchronisation. Der Hauptvorteil liegt in der Stapelverarbeitung.

Preise: Basic – 3,49 $/Monat (25 Minuten). Pro – 14,49 $/Monat (100 Minuten). Geschäftlich – 49,99 $/Monat (500 Minuten). Die preisgünstigste Option auf dem Markt: 0,10–0,14 $ pro Minute Video.

Verwendungszweck: Massenlokalisierung von Kurzvideos in viele Sprachen. Tests neuer GEOs, bei denen es keinen Sinn macht, in Premiumqualität zu investieren, bis die Hypothese bestätigt ist.

Dubverse

Nischentool für asiatische Märkte. Dubverse wurde für den indischen Markt entwickelt und unterstützt Sprachen, die andere Plattformen nicht gut beherrschen: Hindi, Tamil, Telugu, Bengali, Marathi. Für Arbitrage-Händler, die mit asiatischen Tier-2-GEOs zusammenarbeiten, ist dies ein unverzichtbares Tool.

Funktionen: Synchronisierung in mehr als 30 Sprachen (einschließlich 10+ indisch), automatische Transkription, Untertitel, YouTube-Integration.

Preise: ab 12 $/Monat für 40 Minuten. Die Kosten pro Minute betragen etwa 0,30 $. Teurer als Rask AI, aber die Qualität in asiatischen Sprachen ist viel höher.

Verwendungszweck: Lokalisierung für Indien und Südostasien. Wenn Ihr Angebot auf Hindi, Thailändisch oder Indonesisch ist, bietet Dubverse eine bessere Qualität als Universaltools.

Werkzeugvergleich

- ElevenLabs: beste Sprachqualität, 0,07–0,22 $/Min., 30+ Sprachen – für Premium-Inhalte

- HeyGen: All-in-One (Sprache + Lippensynchronisation), 1,6–2,0 $/Min. Video, 40+ Sprachen – für „sprechende Köpfe“

- Rask AI: am günstigsten, 0,10–0,14 $/Min., 130+ Sprachen – für Massenverarbeitung

- Dubverse: am besten für Asien, 0,30 $/Min., 30+ Sprachen – für asiatisches GEO der Stufe 2

Lippensynchronisation: Lippensynchronisation mit neuer Sprachausgabe

Lip Sync ist eine Technologie, die Lippenbewegungen im Video an eine neue Audiospur anpasst. Ohne Lippensynchronisation sieht ein synchronisiertes Talking-Head-Video wie ein alter chinesischer Film mit einer Goblin-Übersetzung aus: Die Lippen sagen das eine, die Stimme sagt das andere. Für Arbitrage-Unternehmen, bei denen Vertrauen Konvertierung bedeutet, ist dies tödlich.

HeyGen (integrierte Lippensynchronisation)

Der einfachste Weg: ein Video hochgeladen → eine Sprache ausgewählt → ein lippensynchrones Video erhalten. HeyGen nutzt ein auf wav2lip basierendes Modell und eigene Entwicklungen. Qualität - 7/10: Bei Nahaufnahmen des Gesichts fallen Artefakte im Mundbereich auf (Unschärfe, „Knetmasse“), bei mittleren und langen Aufnahmen überzeugen sie jedoch.

Funktioniert am besten: 15–30 Sekunden lange Clips, mittlere Aufnahme (Gesicht + Schultern), stabile Beleuchtung, Frontalwinkel.

Probleme: Artefakte beim Drehen des Kopfes, kommt mit Bärten und ungewöhnlichen Lippenformen nicht gut zurecht, manchmal „brechen“ Zähne in Nahaufnahmen.

Sync Labs

API-First-Lösung für fortgeschrittene Benutzer. Sync Labs bietet keine Übersetzung oder Sprachausgabe, sondern nur Lippensynchronisation. Laden Sie eine Video- und Audiospur hoch (von ElevenLabs oder einem anderen TTS) → erhalten Sie ein lippensynchrones Video. Die Qualität ist etwas höher als bei HeyGen – 7,5/10 – aufgrund der präziseren Bearbeitung des Mundbereichs.

Vorteil: Flexibilität. Sie verwenden jede Stimme, jedes TTS, jede Übersetzung – Sync Labs passt nur Ihre Lippen an. Dadurch können Sie die besten Tools kombinieren: Übersetzung über Claude + Sprachausgabe über ElevenLabs + Lippensynchronisation über Sync Labs = maximale Qualität.

Preise: API – 0,35–0,50 $ pro Minute Video. Teurer als die integrierte Lippensynchronisation von HeyGen, aber die Qualität rechtfertigt es.

Wann eine Lippensynchronisation erforderlich ist und wann nicht

- Bedarf: „Talking Head“-Nahaufnahme, Videorezensionen, Ansprache der Kamera – jedes Format, bei dem der Betrachter die Lippen des Sprechers sieht

- Nicht erforderlich: B-Roll mit Voiceover, Produktdemonstration, Motion Graphics, Lifestyle-Videos ohne direkte Ansprache im Bild, Videos mit Textuntertiteln ohne Stimme

- Kompromiss: Wenn die Lippensynchronisation nicht überzeugend aussieht, ändern Sie das Format. Erstellen Sie anstelle eines sprechenden Kopfes eine B-Rolle mit einem Voice-Over. Eine hochwertige KI-Stimme ohne Lippensynchronisation ist besser als die mittelmäßige Lippensynchronisation, die beim Synchronisieren entsteht

Vollständiger Workflow der Multi-Geo-Anpassung: vom Original bis zur Bucht

Die Theorie wurde geklärt, die Werkzeuge wurden ausgewählt. Jetzt – ein spezifischer Schritt-für-Schritt-Prozess, der aus einem Creative Dutzende einzigartige Videos für verschiedene GEOs macht.

Schritt 1: Vorbereiten des Originals

Beginnen Sie mit einem funktionierenden Creative. Dies ist ein Video, das bereits getestet wurde und gute Kennzahlen aufweist – CTR, Bindung, Konvertierung. Passen Sie ungetestete Hypothesen nicht in 10 Sprachen an: Stellen Sie zunächst sicher, dass das Creo in der Muttersprache funktioniert, und skalieren Sie dann.

Extrahieren Sie das Skript aus dem Video. Wenn es sich um Sprache handelt, transkribieren Sie mit Rask AI oder Whisper (kostenlos). Wenn Untertitel vorhanden sind, exportieren Sie die SRT-Datei.

Schritt 2: Übersetzung des Skripts

Übersetzen Sie das Skript mit einem geeigneten Tool (DeepL für europäische Sprachen, Claude für Marketinganpassungen, GPT-4 für asiatische Sprachen). Achten Sie darauf, den CTA anzupassen: „Klicken Sie auf den Link“ für Brasilien – „Toque no link“, nicht das wörtliche „Clique no link“ (beide sind grammatikalisch korrekt, aber der erste klingt für Konversationsinhalte natürlicher).

Schritt 3: KI-Voiceover

Sprechen Sie das übersetzte Skript vor. Für Premium-Qualität – ElevenLabs mit einer geklonten Stimme des Originalsprechers. Für die Massenverarbeitung – Rask AI. Für ein Video mit „sprechendem Kopf“ – HeyGen (Sprachausgabe + Lippensynchronisation in einem Schritt).

Schritt 4: Lippensynchronisation (falls erforderlich)

Wenn das Video einen „sprechenden Kopf“ hat und Sie HeyGen nicht verwendet haben, verwenden Sie Sync Labs: Laden Sie das Originalvideo + neue Audiospur hoch → erhalten Sie ein lippensynchrones Video.

Schritt 5: Postproduktion

Ersetzen Sie Textelemente im Video: Untertitel, Bildschirmtext, CTAs – alles sollte in der Zielsprache sein. Überprüfen Sie das Timing: In einigen Sprachen dauert eine Phrase 30–40 % länger (Deutsch, Russisch), in anderen 20 % weniger (Chinesisch). Passen Sie das Tempo des Voiceovers an oder schneiden/dehnen Sie das Video.

Schritt 6: Einzigartigkeit ist ein wichtiger Schritt bei der Skalierung

Hier verlieren die meisten Arbitrage-Händler Geld. Sie haben beispielsweise fünf Sprachversionen des Videos: Englisch, Spanisch, Portugiesisch, Deutsch, Türkisch. Sie möchten jedes einzelne auf 10–20 Konten im entsprechenden GEO hochladen. Ohne Eindeutigkeit laden Sie dieselbe Datei auf alle Konten hoch – und die Plattform verknüpft sie sofort.

Lösung – 360° Uniquizer. Nach Abschluss der Lokalisierung durchläuft jede Sprachversion 360° Uniquizer, wodurch N eindeutige Kopien erstellt werden – eine für jedes Konto. Jede Kopie unterscheidet sich auf allen Verifizierungsebenen von den anderen:

- Wahrnehmungs-Hashes (pHash): Farbraumverschiebung, Zuschneiden, Geometrieänderung – der Hash jeder Kopie ist einzigartig

- Audio-Fingerabdruck: Transformation der Audiospur (Tonhöhe, Geschwindigkeit, Hintergrundgeräusch) – auch wenn die Sprachausgabe gleich ist, ist der Klang-Fingerabdruck unterschiedlich

- Metadata: vollständige Neugenerierung – andere Bitrate, Codec, Erstellungsdatum. Jede Datei ist technisch neu

- Bearbeitung: Fragmente neu anordnen, Dauer von Szenen ändern – neuronale Netzwerkanalyse der Plattform sieht unterschiedliche Inhalte

Skalierungsformel: 1 Original × 5 Sprachen × 20 Konten = 100 eindeutige Dateien. Ohne 360° Uniquizer sind das 5 Dateien und 100 verknüpfte Konten. Es enthält 100 unabhängige Inhalte, von denen jeder als Original verifiziert ist.

360° Uniquizer ist ein notwendiger Link in einem Multigeo-Workflow. Die gesamte Übersetzungs- und Sprachausgabekette wird bedeutungslos, wenn Konten beim Hochladen durch Inhalte verknüpft werden. Die Software arbeitet lokal auf Ihrem Computer, verarbeitet sie stapelweise – legen Sie sie in einem Ordner mit Sprachversionen ab, geben Sie die Anzahl der Kopien jeder einzelnen an und erhalten Sie vorgefertigte Inhalte für alle Konten.

Schritt 7: Bucht gemäß GEO

Jedes Konto erhält seine eigene, einzigartige Version. Beim Hochladen werden die Zeitzonen des Ziel-GEO berücksichtigt – 18:00–21:00 Uhr Ortszeit für die meisten Märkte. Verwenden Sie einen Proxy des entsprechenden GEO. Laden Sie nicht alle Konten gleichzeitig hoch – führen Sie die Phase 10–15 Minuten lang durch.

Fallstricke: Schwerpunkt, Kultur, Kosten und andere Fallstricke

KI-Lokalisierung ist ein leistungsstarkes Werkzeug, aber die Liste der Fehler, die Budgets verschwenden, ist lang. Jede dieser Fallen kostet jemanden Geld und Konten.

Falscher Akzent und Dialekt

Spanisch für Spanien und Spanisch für Mexiko sind aus Marketingsicht zwei verschiedene Sprachen. „Coger“ bedeutet in Spanien „nehmen“, in Lateinamerika ist es ein Vulgarismus. Die portugiesische Sprache für Brasilien und Portugal verhält sich ähnlich. KI-Tools generieren standardmäßig eine „neutrale“ Version der Sprache, die für einen bestimmten Markt möglicherweise unnatürlich klingt.

Lösung: Geben Sie beim Übersetzen über Claude oder GPT-4 den spezifischen Dialekt in der Eingabeaufforderung an: „Brasilianisches Portugiesisch, Konversationsstil, Publikum 18–30 Jahre, Sao Paulo.“ Wählen Sie in ElevenLabs Stimmen aus, die mit einer bestimmten Region gekennzeichnet sind. Geben Sie in Rask AI die Sprachoption an (PT-BR vs. PT-PT, ES-MX vs. ES-ES).

Kulturelles Missverhältnis

Es reicht nicht aus, den Text zu übersetzen. Auch die Visuals müssen GEO entsprechen. Eine Blondine in Nutra-Creo ist ein kulturelles Missverhältnis für Thailand. Die Demonstration von Alkohol in Creo ist für arabische Länder ein sofortiges Verbot. Gesten, die in einer Kultur normal sind, sind in einer anderen Kultur beleidigend. Die „OK“-Geste (Daumen und Zeigefinger im Ring) ist in Brasilien beleidigend.

Lösung: Passen Sie nicht nur den Ton und den Text an, sondern auch die visuellen Elemente. Geben Sie für AI-Bildgenerierung und Video die ethnische Zugehörigkeit und den kulturellen Kontext des Ziel-GEO an. Oder verwenden Sie ein „neutrales“ Bildmaterial – Nahaufnahme des Produkts, Hände ohne Gesicht, abstrakte Animationen.

Slang und Redewendungen

„Das ist eine Bombe“ auf Russisch → „Das ist eine Bombe“ auf Englisch ist im wahrsten Sinne des Wortes Unsinn. „Pumpen“ → nicht „Pumpen“. KI-Übersetzer sind im Jahr 2026 besser geworden, haben aber immer noch Probleme mit Slang und Redewendungen. Besonders gefährlich ist es in hooks – den ersten 3 Sekunden des Videos, in denen jedes Wort zählt.

Lösung: Übersetzen Sie den CTA und die Hooks separat durch Claude mit einer Eingabeaufforderung, in der der Kontext erläutert wird. Oder erstellen Sie ein Glossar mit Zielphrasen für jeden GEO und verwenden Sie es als Referenz. Ein einfacher, verständlicher Satz ist besser als ein erfolgloser Versuch, den Slang anzupassen.

KI-Synchronisation vs. professionelle Ansager: Wann sollte man was wählen

AI-Überspielen ist 10- bis 30-mal günstiger und schneller. Aber es gibt Szenarien, in denen ein Live-Ansager gerechtfertigt ist:

- KI-Synchronisation (2–8 $ pro Video): kurze Videos 15–60 Sekunden, Tier 2 GEO, Massenhypothesetests, Videos ohne Nahaufnahmen des Gesichts

- Live-Ansager (50–200 $ pro Video + Übersetzung): Lange Inhalte für Trichter, Tier-1-GEO mit einem anspruchsvollen Publikum, Markeninhalte mit erkennbarer Stimme, rechtlich sensible Branchen

Für 90 % der Schlichtungsprobleme ist die KI-Duplizierung die optimale Wahl. Die Qualität im Jahr 2026 ist recht hoch, aber die Iterationsgeschwindigkeit ist unvergleichlich. Sie können 5 Sprachen an einem Tag testen, anstatt eine Woche auf eine Antwort von Sprechern zu warten.

Plattformfallen

TikTok erkennt in einigen GEOs automatisch KI-Sprachausgabe und kann die Abdeckung verringern. Vor allem Standardstimmen von kostenlosen TTS-Diensten, die der Algorithmus bereits „gelernt“ hat. Lösung: Verwenden Sie geklonte Stimmen über ElevenLabs – sie klingen einzigartig und sind nicht in der Datenbank der erkannten KI-Stimmen enthalten. Plus obligatorische Eindeutigkeit über 360° Uniquizer – Audiotransformation verwirrt zusätzlich die KI-Erkennung.

Instagram Reels moderiert Inhalte in „sensiblen“ Sprachen (Arabisch, Hindi) strenger – automatische Synchronisierung kann Filter auslösen. Überprüfen Sie jede Lokalisierung vor dem Massen-Upload auf Moderationsflags.

YouTube Shorts ist loyaler gegenüber doppelten Inhalten (YouTube selbst fördert aktiv die mehrsprachige Synchronisationsfunktion), erfordert jedoch korrekte Metadaten – die Videosprache muss mit der Sprache der Audiospur übereinstimmen.

Hauptfehler: Lokalisierung ohne Eindeutigkeit

Lassen Sie uns den Kerngedanken wiederholen, denn dieser Fehler kostet mehr als alle anderen zusammen. Sie haben Zeit und Geld für Übersetzung, Sprachausgabe und Lippensynchronisation aufgewendet – Sie haben 5 Sprachversionen des Videos erhalten. Und laden Sie jede Version auf 20 Konten im entsprechenden GEO hoch. Nach 24 Stunden sind alle Konten verknüpft – da die Plattform 20 identische Dateien mit denselben Hashes sieht.

360° Uniquizer ist das letzte und obligatorische Glied in der Kette. Ohne sie verliert jede Lokalisierung in der Skalierungsphase ihre Bedeutung. Damit verwandelt sich ein arbeitender Kreativer in Hunderte einzigartiger Inhalte, von denen jeder autonom in seinem eigenen GEO auf seinem eigenen Konto arbeitet.

Lesen Sie auch

- KI-Videogenerierung für Schiedsverfahren 2026: Sora, Kling, Runway – wie man neuronale Netze für Creo nutzt

- So wählen Sie einen GEO für die Verkehrsschlichtung aus: Tier-1, Tier-2, Tier-3 und ihre Funktionen

- Crossposting auf TikTok/Instagram/YouTube ohne Reichweitenverlust: So passen Sie Inhalte für jede Plattform an

Multi-Geo-Arbitrage ist der maximale ROI für ein Motiv. Mit KI-Übersetzung und Sprachausgabe erhalten Sie innerhalb von Stunden 5–10 Sprachversionen. 360° Uniquizer wandelt jede Version in Dutzende einzigartiger Dateien um, um eine sichere Skalierung über Konten hinweg zu ermöglichen. Ergebnis: ein Video → 5 Sprachen → 100 einzigartige Versionen → 100 unabhängige Konten in 5 GEOs. Keine Inhaltslinks, keine KI-Erkennung, keine Probleme mit der Moderation.

Versuchen Sie es mit 360° Uniquizer – laden Sie lokalisierte Videos hoch und erhalten Sie einzigartige Versionen für jedes Konto in jedem GEO. Funktioniert lokal, ohne Cloud, Stapelverarbeitung aller Sprachversionen in wenigen Minuten.

FAQ

Welches Tool eignet sich besser für die KI-Stimmung von Videos für Schiedsverfahren?

Abhängig von der Aufgabe. ElevenLabs – Beste Sprachqualität und Klonen, ideal für Redner und Eingeweide. HeyGen ist die beste Option, wenn Sie Synchronisation + Lippensynchronisation in einem Instrument benötigen, ohne manuelles Kleben. Rask AI eignet sich optimal für die Streaming-Verarbeitung, wenn Sie schnell Dutzende Videos übersetzen müssen. Dubverse ist die günstigste Option für Tier-2-GEO (Indien, Südostasien). Um nach der Sprachausgabe zu skalieren, muss jede Sprachversion über 360° Uniquizer eindeutig sein. Andernfalls wird ein doppeltes Video auf mehreren Konten das gesamte Raster verknüpfen.

Wie viel kostet die Synchronisierung von KI-Videos im Vergleich zu einem Live-Erzähler?

Die AI-Überspielung eines 10-minütigen Videos kostet über Rask AI oder ElevenLabs 2–8 US-Dollar. Ein professioneller Ansager für den gleichen Umfang berechnet 50–200 US-Dollar pro Sprache, plus 30–80 US-Dollar für die Drehbuchübersetzung. Auf einer Skala ist der Unterschied enorm: Die Lokalisierung eines Motivs in fünf Sprachen durch KI kostet 10–40 US-Dollar, durch Live-Spezialisten 400–1.400 US-Dollar. Gleichzeitig dauert die KI-Synchronisierung Minuten und die Arbeit mit Ansagern Tage. Für die Schlichtung, bei der die Iterationsgeschwindigkeit von entscheidender Bedeutung ist, ist die KI-Duplizierung die einzige Wahl.

Ist eine Lippensynchronisation für die KI-Videosynchronisierung für ein Schiedsverfahren erforderlich?

Abhängig vom Format. Für einen „sprechenden Kopf“ – ja, die Lippensynchronisation ist von entscheidender Bedeutung: Eine Diskrepanz zwischen Lippen und Sprache verrät sofort die Synchronisation und verliert das Selbstvertrauen. Für Lifestyle-Videos mit Voice-Over, B-Roll oder Motion Graphics ist keine Lippensynchronisation erforderlich, eine hochwertige Sprachausgabe reicht aus. HeyGen und Sync Labs bieten eine akzeptable Lippensynchronisation für kurze Videos bis zu 60 Sekunden. Bei langen Videos mit Nahaufnahmen des Gesichts ist die Qualität immer noch unzureichend – Artefakte sind erkennbar.

Warum muss das Video nach der KI-Übersetzung und Sprachausgabe einzigartig sein?

Weil die KI-Übersetzung eine Version des Videos für jede Sprache erstellt – und Sie diese Version auf 10–50 Konten in einem bestimmten GEO hochladen. Ohne Eindeutigkeit sieht die Plattform dieselbe Datei mit denselben Hashes, demselben Audio-Fingerabdruck und denselben Metadaten – und verknüpft alle Konten. 360° Uniquizer löst dieses Problem: Aus einer Sprachversion werden N eindeutige Dateien erstellt, die sich jeweils in allen Verifizierungsstufen unterscheiden. Formel: 1 Original × 5 Sprachen × 20 Konten = 100 eindeutige Dateien über 360° Uniquizer.