Na arbitragem de tráfego, o trabalho criativo é o ativo mais valioso. Mas o seu potencial está limitado a uma língua e a um GEO. Em 2026, as ferramentas de IA para tradução e narração derrubaram essa barreira: um vídeo pode ser adaptado para 5 a 10 idiomas em horas, sem locutores e tradutores profissionais. ElevenLabs, HeyGen, Rask AI, Dubverse - para dublagem. DeepL, Claude, GPT-4 - para tradução de scripts. Sync Labs - para sincronização labial. Mas a adaptação multigeográfica tem armadilhas que não são visíveis à primeira vista: o sotaque errado pode matar conversões, a inconsistência cultural pode causar negatividade e a mesma versão duplicada em dezenas de contas pode arruinar toda a rede. Este artigo contém uma análise completa das ferramentas, um passo a passo do fluxo de trabalho desde o original até o upload, preços reais e erros que desperdiçam orçamentos.

Por que um comerciante afiliado precisa de multigeografia: economia da localização

A lógica é simples: um criativo funcional é uma hipótese testada. Você já gastou tempo e dinheiro em testes, encontrou uma combinação que converte. Agora a questão é como tirar o máximo proveito disso. A maneira mais óbvia de escalar é aumentar o número de contas em um GEO. Mas há um limite: o público é finito, a concorrência está crescendo, criativos esgotam. Multigeo remove este teto.

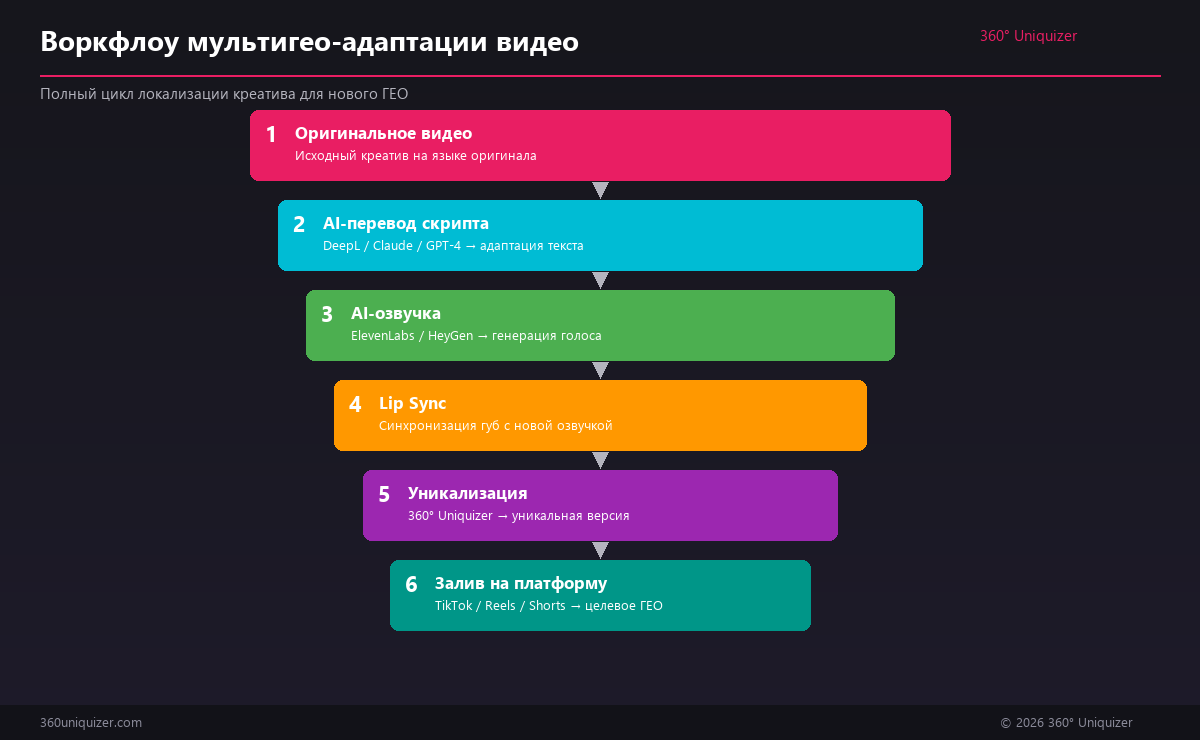

Ciclo completo de localização criativa de IA para um novo GEO

Um vídeo adaptado para o espanhol é o acesso aos mercados da Espanha, México, Argentina, Colômbia. Em português - Brasil, Portugal. Em alemão - Alemanha, Áustria, Suíça. Turco, tailandês e indonésio são enormes mercados de nível 2 com baixa concorrência. Um criativo se transforma em 5 a 10 campanhas separadas com grades de contas separadas.

Nível 1 vs Nível 2: onde adaptar

Nível 1 (EN, DE, FR, ES, IT, JP) - pagamentos de CPA elevados, mas concorrência acirrada e tráfego caro. A localização para esses idiomas se justifica quando a oferta paga mais de US$ 30 por conversão. A qualidade da tradução e da dublagem deve ser impecável - o público é sensível ao som “máquina”.

Nível 2 (PT-BR, TR, TH, ID, PL, RO, HI, AR) - os pagamentos são mais baixos (US$ 5–15 por conversão), mas a concorrência é mínima e os volumes de tráfego são enormes. Brasil - 220 milhões de habitantes, Indonésia - 280 milhões, Índia - 1,4 bilhão. Mesmo com pagamentos modestos, o volume compensa tudo. Os requisitos de qualidade para dublagem são mais baixos - o público está acostumado com conteúdo dublado.

Estratégia ideal: comece com idiomas de nível 2, onde a concorrência é menor e os erros de localização são menos críticos. Pratique seu fluxo de trabalho e depois dimensione para o Nível 1 com adaptação de maior qualidade. Anteriormente, localizar um vídeo em 5 idiomas custava entre US$ 500 e 1.500 (tradutores + locutores) e demorava uma semana. Agora - US$ 10-50 e algumas horas. A IA tornou o multigeo acessível a qualquer comerciante afiliado.

Tradução AI de roteiros e legendas: DeepL, Claude, GPT-4

A tradução é a primeira etapa da localização. Antes de dublar um vídeo em outro idioma, você precisa traduzir o roteiro. E aqui é extremamente importante não apenas traduzir as palavras, mas adaptar a mensagem de marketing à cultura do GEO alvo. Um tradutor comum (ou o Google Translate) não consegue lidar com isso - você precisa de ferramentas que entendam o contexto.

DeepL

O melhor tradutor automático para línguas europeias. O DeepL produz consistentemente traduções que soam naturais, especialmente em alemão, francês, espanhol, polaco e português. Suporta registro formal e informal - fundamental para texto de marketing.

Fortes: Idiomas europeus, precisão de tom, integração de API para processamento em lote. Plano gratuito - 500.000 caracteres/mês. Pró – $ 8,74/mês.

Restrições: mais fraco em idiomas asiáticos (tailandês, indonésio, hindi). Não adapta gírias e CTA a um mercado específico – traduz literalmente. Não entende a terminologia de arbitragem.

Claude

A ferramenta mais poderosa para adaptação de textos de marketing. Claude entende o contexto em um nível profundo: se você explicar que o texto é um roteiro de um comercial no nutra-vertical para um público brasileiro, ele adapta não só a linguagem, mas também o estilo de entrega, os turnos de conversação e o CTA.

Fortes: adaptação contextual, trabalho com gírias, capacidade de definir o tom e o público-alvo através de um prompt do sistema. Faz um excelente trabalho com localização de CTA: “Compre agora” não se transforma em uma tradução literal, mas em uma frase de conversão para um GEO específico.

Limitações: é mais caro que o DeepL para textos grandes. Requer uma indicação competente – sem contexto, traduz-se como “literário demais”. Pode recusar-se a traduzir linguagem de marketing agressiva.

GPT-4

Uma ferramenta universal com a mais ampla cobertura linguística. O GPT-4 lida até com idiomas raros (tagalo, vietnamita, suaíli), onde DeepL e Claude são mais fracos. Através do prompt do sistema, você pode definir parâmetros exatos: “Traduzir como texto falado para um vídeo TikTok, público-alvo: mulheres de 25 a 35 anos, México, tom informal.”

Fortes: cobertura máxima de idioma, prompts de sistema flexíveis, API para automação. Lida bem com a adaptação de dados numéricos (moeda, unidades de medida) para GEO.

Limitações: a qualidade da tradução para idiomas europeus é inferior à do DeepL. Às vezes “alucina” - acrescenta informações que não estavam no original. Requer verificação de falante nativo para nível 1 GEO.

Como escolher uma ferramenta de tradução

- Idiomas europeus (DE, FR, ES, IT, PL, PT): DeepL para tradução básica → Claude para personalizar CTAs e linguagem de marketing

- Idiomas asiáticos e raros (TH, ID, HI, AR, VI): GPT-4 com prompt detalhado do sistema

- Legendas (SRT/VTT): DeepL via API - rápido, barato, preciso o suficiente para legendas

- Roteiros de marketing e CTA: Claude com um prompt descrevendo a vertical, público e GEO

Dica: Sempre traduza o CTA separadamente do texto principal. “Saiba mais”, “Compre agora”, “Ganhe um desconto” - essas frases devem soar nativas de um mercado específico, e não como uma cópia do russo ou inglês. Gaste 5 minutos na engenharia imediata do CTA - terá retorno na conversão.

Locução de vídeo AI: ElevenLabs, HeyGen, Rask AI, Dubverse

O script foi traduzido - agora precisamos dar voz a ele. Em 2026, a dublagem de IA atingiu um nível em que o espectador médio não consegue distinguir uma voz de rede neural de um locutor ao vivo. Mas as ferramentas são projetadas para tarefas diferentes - e escolher a ferramenta errada consumirá o orçamento ou prejudicará a qualidade.

ElevenLabs

Líder de mercado em qualidade de voz. ElevenLabs é sobre som: entonação, pausas, coloração emocional - tudo é o mais próximo possível da fala ao vivo. O principal recurso é a clonagem de voz: carregue 30 segundos de áudio com voz e a rede neural reproduz essa voz em mais de 30 idiomas.

Recursos: conversão de texto em fala em mais de 30 idiomas, clonagem de voz, controle de emoção e velocidade, API de processamento em lote. Suporta marcação SSML para ajuste fino de pausas e acentos.

Preço: Inicial - US$ 5/mês (30 minutos de áudio). Criador – $ 22/mês (100 minutos). Pró – $ 99/mês (500 minutos). Para volume de arbitragem, Creator ou Pro é ideal. O custo por minuto é de US$ 0,07–0,22 dependendo da tarifa.

Quando usar: “talking head”, narração, qualquer formato onde a qualidade da voz seja crítica. Ideal para encontros e encontros, onde a confiança na voz afeta diretamente a conversão.

EiGen

Combine: tradução + dublagem + sincronização labial em um instrumento. Carregar um vídeo - HeyGen transcreve automaticamente a fala, traduz-a para o idioma selecionado, expressa-a com uma voz de rede neural e sincroniza os movimentos dos lábios. Todo o processo leva um clique.

Recursos: tradução de vídeo ponta a ponta, sincronização labial integrada, mais de 40 idiomas, clonagem de voz, geração de avatar de IA. Suporta o carregamento de um script finalizado - se você o traduziu através de Claude ou DeepL, você pode usar sua própria tradução em vez da automática.

Preço: Criador - US$ 24/mês (15 minutos de vídeo). Negócios – $ 60/mês (30 minutos). Empresa - individualmente. O custo por minuto de vídeo é de US$ 1,6–2,0. Mais caro do que a narração pura através do ElevenLabs, mas inclui sincronização labial.

Quando usar: vídeos de talk shows onde a sincronização labial é necessária. Uma ferramenta em vez de uma cadeia de três - economizando tempo durante localizações em grande escala.

Rask AI

A melhor ferramenta para processamento de stream. Rask AI foi projetado para volume: carregue dezenas de vídeos, selecione os idiomas de destino - o sistema processa tudo em lote. A qualidade da dublagem é inferior à do ElevenLabs, mas para GEO Tier 2 e vídeos curtos (15–60 segundos) é mais que suficiente.

Recursos: transcrição automática, tradução para mais de 130 idiomas, dublagem de IA com seleção de voz, legendas automáticas, sincronização labial básica. O processamento em lote é a principal vantagem.

Preço: Básico - US$ 3,49/mês (25 minutos). Pró – $ 14,49/mês (100 minutos). Negócios – $ 49,99/mês (500 minutos). A opção mais econômica do mercado: US$ 0,10–0,14 por minuto de vídeo.

Quando usar: localização em massa de vídeos curtos em vários idiomas. Testes de novos GEOs, onde não adianta investir em qualidade premium até que a hipótese seja confirmada.

Dubverse

Ferramenta de nicho para mercados asiáticos. O Dubverse foi criado para o mercado indiano e suporta idiomas que outras plataformas não suportam bem: Hindi, Tamil, Telugu, Bengali, Marathi. Para traders de arbitragem que trabalham com GEOs asiáticos de nível 2, esta é uma ferramenta indispensável.

Recursos: dublagem em mais de 30 idiomas (incluindo mais de 10 indianos), transcrição automática, legendas, integração com o YouTube.

Preço: a partir de US$ 12/mês por 40 minutos. O custo por minuto é de cerca de US$ 0,30. Mais caro que o Rask AI, mas a qualidade nos idiomas asiáticos é muito superior.

Quando usar: localização para Índia e Sudeste Asiático. Se a sua oferta for em hindi, tailandês ou indonésio, o Dubverse fornecerá melhor qualidade do que as ferramentas universais.

Comparação de ferramentas

- ElevenLabs: melhor qualidade de voz, US$ 0,07–0,22/min, mais de 30 idiomas - para conteúdo premium

- HeyGen: tudo-em-um (voz + sincronia labial), vídeo de US$ 1,6–2,0/min, mais de 40 idiomas - para “talking heads”

- Rask AI: mais barato, US$ 0,10–0,14/min, mais de 130 idiomas - para processamento em massa

- Dubverse: melhor para Ásia, US$ 0,30/min, mais de 30 idiomas - para nível 2 asiático GEO

Sincronização labial: sincronização labial com nova dublagem

Lip sync é uma tecnologia que ajusta os movimentos dos lábios no vídeo para uma nova faixa de áudio. Sem sincronização labial, um vídeo dublado de um talk head parece um filme chinês antigo com tradução de Goblin: os lábios dizem uma coisa, a voz diz outra. Para creos de arbitragem, onde confiança é conversão, isso é mortal.

HeyGen (sincronização labial integrada)

A maneira mais fácil: enviou um vídeo → selecionou um idioma → recebeu um vídeo sincronizado com os lábios. HeyGen usa um modelo baseado em wav2lip e seus próprios desenvolvimentos. Qualidade - 7/10: em close-ups do rosto, os artefatos na região da boca são perceptíveis (desfoque, “plasticina”), mas em planos médios e longos são convincentes.

Funciona melhor: clipes de 15 a 30 segundos, plano médio (rosto + ombros), iluminação estável, ângulo frontal.

Problemas: artefatos ao virar a cabeça, não lida bem com barbas e formatos incomuns de lábios, às vezes “quebra” dentes em close-ups.

Laboratórios de sincronização

API-first solução para usuários avançados. O Sync Labs não oferece tradução ou dublagem - apenas sincronização labial. Carregue uma faixa de vídeo + áudio (do ElevenLabs ou outro TTS) → obtenha um vídeo sincronizado com os lábios. A qualidade é um pouco superior à HeyGen - 7,5/10 - devido ao processamento mais preciso da área da boca.

Vantagem: flexibilidade. Você usa qualquer voz, qualquer TTS, qualquer tradução - o Sync Labs ajusta apenas seus lábios. Isso permite combinar as melhores ferramentas: tradução via Claude + dublagem via ElevenLabs + sincronização labial via Sync Labs = qualidade máxima.

Preços: API - US$ 0,35–0,50 por minuto de vídeo. Mais caro que a sincronização labial integrada HeyGen, mas a qualidade justifica.

Quando a sincronização labial é necessária e quando não é

- Necessário: close-up da “cabeça falante”, análises de vídeo, endereçamento para a câmera - qualquer formato em que o espectador veja os lábios do locutor

- Não é necessário: B-roll com narração, demonstração de produto, gráficos em movimento, vídeos de estilo de vida sem fala direta no quadro, vídeos com legendas de texto sem voz

- Compromisso: se a sincronização labial não parecer convincente, altere o formato. Em vez de uma cabeça falante, faça um B-roll com narração. Uma voz de IA de alta qualidade sem sincronização labial é melhor do que a sincronização labial medíocre que a dublagem produz

Fluxo de trabalho completo de adaptação multigeográfica: do original à baía

A teoria foi resolvida, as ferramentas foram selecionadas. Agora - um processo passo a passo específico que transforma um criativo em dezenas de vídeos exclusivos para diferentes GEOs.

Etapa 1: Prepare o original

Comece com um criativo funcional. Este é um vídeo que já foi testado e apresentou boas métricas – CTR, retenção, conversão. Não adapte hipóteses não testadas em 10 idiomas: primeiro confirme se o creo funciona no idioma nativo e depois dimensione.

Extraia o script do vídeo. Se for fala, transcreva usando Rask AI ou Whisper (gratuito). Se houver legendas, exporte o arquivo SRT.

Etapa 2: Tradução do script

Traduza o roteiro através de uma ferramenta adequada (DeepL para idiomas europeus, Claude para adaptações de marketing, GPT-4 para idiomas asiáticos). Certifique-se de adaptar o CTA: “Clique no link” para o Brasil - “Toque no link”, não o literal “Clique no link” (ambos estão gramaticalmente corretos, mas o primeiro parece mais natural para conteúdo conversacional).

Etapa 3: narração de IA

Fale o script traduzido. Para qualidade premium - ElevenLabs com voz clonada do alto-falante original. Para processamento em massa - Rask AI. Para um vídeo com uma “cabeça falante” - HeyGen (dublagem + sincronização labial em uma única etapa).

Etapa 4: sincronização labial (se necessário)

Se o vídeo tiver uma “cabeça falante” e você não usou o HeyGen, use o Sync Labs: carregue o vídeo original + nova faixa de áudio → obtenha um vídeo sincronizado com os lábios.

Etapa 5: Pós-produção

Substitua os elementos de texto no vídeo: legendas, texto na tela, CTAs - tudo deve estar no idioma de destino. Verifique o tempo: em alguns idiomas uma frase demora de 30 a 40% mais (alemão, russo), em outros leva 20% menos (chinês). Ajuste o andamento da narração ou corte/estique o vídeo.

Etapa 6: A exclusividade é uma etapa fundamental no dimensionamento

É aqui que a maioria dos traders de arbitragem perde dinheiro. Por exemplo, você tem versões do vídeo em 5 idiomas: inglês, espanhol, português, alemão, turco. Você deseja fazer upload de cada uma para 10 a 20 contas no GEO correspondente. Sem exclusividade, você carrega o mesmo arquivo para todas as contas - e a plataforma as vincula instantaneamente.

Solução - 360° Uniquizer. Após a conclusão da localização, cada versão de idioma passa por 360° Uniquizer, que cria N cópias exclusivas - uma para cada conta. Cada cópia é diferente das demais em todos os níveis de verificação:

- Hashes perceptuais (pHash): mudança de espaço de cores, corte, alteração de geometria - o hash de cada cópia é único

- Impressão digital de áudio: transformação da trilha de áudio (tom, velocidade, som de fundo) - mesmo que a dublagem seja a mesma, a impressão digital sonora é diferente

- Metadados: regeneração completa - taxa de bits, codec e data de criação diferentes. Cada arquivo é tecnicamente novo

- Edição: reorganizando fragmentos, alterando a duração das cenas - a análise da rede neural da plataforma vê conteúdo diferente

Fórmula de escala: 1 original × 5 idiomas × 20 contas = 100 arquivos únicos. Sem 360° Uniquizer são 5 arquivos e 100 contas vinculadas. Ele vem com 100 conteúdos independentes, cada um verificado como original.

360° Uniquizer é um link necessário em um fluxo de trabalho multigeográfico. Toda a cadeia de tradução e dublagem perde o sentido se, na fase de upload, as contas estiverem conectadas por meio de conteúdo. O software funciona localmente no seu computador, processa em lotes - coloque em uma pasta com as versões dos idiomas, indique a quantidade de cópias de cada uma e receba conteúdo pronto para todas as contas.

Etapa 7: Bay de acordo com GEO

Cada conta recebe sua própria versão exclusiva. Faça upload levando em consideração os fusos horários do GEO alvo - 18h00–21h00 horário local para a maioria dos mercados. Use um proxy do GEO apropriado. Não carregue todas as contas ao mesmo tempo - aguarde de 10 a 15 minutos.

Armadilhas: ênfase, cultura, custo e outras armadilhas

A localização AI é uma ferramenta poderosa, mas a lista de erros que desperdiçam orçamentos é longa. Cada uma dessas armadilhas custa dinheiro e contas a alguém.

Sotaque e dialeto incorretos

Espanhol para Espanha e espanhol para México são dois idiomas diferentes do ponto de vista de marketing. “Coger” em Espanha significa “tomar”, na América Latina é um vulgarismo. O português para o Brasil e para Portugal é uma história semelhante. Por padrão, as ferramentas de IA geram uma versão “neutra” da linguagem, o que pode parecer pouco natural para um determinado mercado.

Solução: ao traduzir via Claude ou GPT-4, indique o dialeto específico no prompt: “Português do Brasil, estilo conversacional, público de 18 a 30 anos, São Paulo.” No ElevenLabs, selecione vozes marcadas com uma região específica. No Rask AI - especifique a opção de idioma (PT-BR vs PT-PT, ES-MX vs ES-ES).

Incompatibilidade cultural

Traduzir o texto não é suficiente. Os visuais também devem corresponder ao GEO. Uma loira de nutra-creo é uma incompatibilidade cultural para a Tailândia. A demonstração de álcool in creo para os países árabes é uma proibição instantânea. Gestos que são normais numa cultura são ofensivos em outra. O gesto “OK” (polegar e indicador em um anel) é ofensivo no Brasil.

Solução: adapta não apenas o som e o texto, mas também o visual. Para AI geração de imagem e vídeo, indique a etnia e o contexto cultural do GEO alvo. Ou use um visual “neutro” - close-up do produto, mãos sem rosto, animações abstratas.

Gírias e expressões idiomáticas

“This is a bomb” em russo → “This is a bomb” em inglês é literalmente um absurdo. “Bombas” → não “bombas”. Os tradutores de IA melhoraram em 2026, mas ainda lutam com gírias e expressões idiomáticas. É especialmente perigoso em hooks - os primeiros 3 segundos do vídeo, onde cada palavra conta.

Solução: traduza o CTA e os ganchos separadamente, por meio de Claude com um prompt explicando o contexto. Ou crie um glossário de frases-alvo para cada GEO e use-o como referência. Uma frase simples e compreensível é melhor do que uma tentativa malsucedida de adaptar uma gíria.

Dublagem AI vs locutores profissionais: quando escolher o quê

A dublagemAI é 10–30 vezes mais barata e mais rápida. Mas há cenários em que um locutor ao vivo se justifica:

- Dublagem AI (US$ 2–8 por vídeo): vídeos curtos de 15 a 60 segundos, nível 2 GEO, testes de hipóteses em massa, vídeos sem close-ups do rosto

- Locutor ao vivo (US$ 50–200 por vídeo + tradução): conteúdo de formato longo para funis, nível 1 GEO com um público exigente, conteúdo de marca com voz reconhecível, verticais legalmente sensíveis

Para 90% dos problemas de arbitragem, a duplicação de IA é a escolha ideal. A qualidade em 2026 é bastante alta, mas a velocidade de iteração é incomparável. Você pode testar 5 idiomas em um dia em vez de esperar uma semana pela resposta dos palestrantes.

Armadilhas de plataforma

TikTok em alguns GEOs detecta automaticamente a dublagem de IA e pode reduzir a cobertura. Especialmente vozes padrão de serviços TTS gratuitos que o algoritmo já “aprendeu”. Solução: use vozes clonadas por meio do ElevenLabs - elas soam únicas e não estão incluídas no banco de dados de vozes de IA detectadas. Além da exclusividade obrigatória via 360° Uniquizer - a transformação de áudio também confunde a detecção de IA.

Instagram Reels modera mais estritamente o conteúdo em idiomas “sensíveis” (árabe, hindi) - a dublagem automática pode acionar filtros. Verifique cada localização para sinalizadores de moderação antes do upload em massa.

YouTube Shorts é mais fiel ao conteúdo duplicado (o próprio YouTube está promovendo ativamente a função de dublagem multilíngue), mas requer metadados corretos - o idioma do vídeo deve corresponder ao idioma da faixa de áudio.

Erro principal: localização sem exclusividade

Vamos repetir a ideia chave, porque esse erro custa mais que todos os outros juntos. Você gastou tempo e dinheiro em tradução, dublagem, sincronização labial - você recebeu versões do vídeo em 5 idiomas. E carregue cada versão em 20 contas no GEO correspondente. Após 24 horas, todas as contas estão vinculadas – porque a plataforma vê 20 arquivos idênticos com os mesmos hashes.

360° Uniquizer é o elo final e obrigatório da cadeia. Sem ele, toda localização perde seu significado na fase de dimensionamento. Com ele, um criativo funcional se transforma em centenas de peças de conteúdo exclusivas, cada uma das quais funciona de forma autônoma em seu próprio GEO por conta própria.

Leia também

A arbitragem multigeográfica é o ROI máximo para um criativo. A tradução e a dublagem por IA oferecem de 5 a 10 versões em idiomas em horas. 360° Uniquizer transforma cada versão em dezenas de arquivos exclusivos para escalonamento seguro entre contas. Resultado: um vídeo → 5 idiomas → 100 versões exclusivas → 100 contas independentes em 5 GEOs. Sem links de conteúdo, sem detecção de IA, sem problemas de moderação.

Experimente 360° Uniquizer - carregue vídeos localizados e obtenha versões exclusivas para cada conta em cada GEO. Funciona localmente, sem nuvem, processamento em lote de todas as versões de idiomas em minutos.

FAQ

Qual ferramenta é melhor para vídeo com voz de IA para arbitragem?

Depende da tarefa. ElevenLabs - Melhor qualidade de voz e clonagem, ideal para falantes e entranhas. HeyGen é a melhor opção se você precisa de dublagem + sincronia labial em um instrumento, sem colagem manual. Rask AI é ideal para processamento de streaming quando você precisa traduzir rapidamente dezenas de vídeos. Dubverse é a opção mais econômica para GEO Tier 2 (Índia, Sudeste Asiático). Para escalar após a dublagem, cada versão de idioma deve ser exclusiva por meio de 360° Uniquizer. Caso contrário, um vídeo duplicado em várias contas vinculará toda a grade.

Quanto custa a dublagem de vídeo com IA em comparação com um narrador ao vivo?

A dublagem AI de um vídeo de 10 minutos custa US$ 2–8 por meio do Rask AI ou ElevenLabs. Um locutor profissional para o mesmo volume cobra US$ 50–200 por idioma, mais US$ 30–80 pela tradução do roteiro. Em uma escala, a diferença é colossal: localizar um criativo em 5 idiomas por meio de IA custa de US$ 10 a 40, por meio de especialistas ao vivo — de US$ 400 a 1.400. Ao mesmo tempo, a dublagem de IA leva minutos e trabalhar com locutores leva dias. Para arbitragem, onde a velocidade de iteração é crítica, a duplicação de IA é a única opção.

A sincronização labial é necessária para dublagem de vídeo AI para arbitragem?

Depende do formato. Para uma “cabeça falante” - sim, a sincronização labial é extremamente importante: uma discrepância entre os lábios e a fala denuncia instantaneamente a dublagem e perde a confiança. Para vídeos de estilo de vida com narração, B-roll ou gráficos em movimento, a sincronização labial não é necessária; a dublagem de alta qualidade é suficiente. HeyGen e Sync Labs fornecem sincronização labial aceitável para vídeos curtos de até 60 segundos. Para vídeos longos com close-ups do rosto, a qualidade ainda é insuficiente - artefatos são perceptíveis.

Por que o vídeo precisa ser único depois da tradução por IA e da dublagem?

Porque a tradução AI cria uma versão do vídeo para cada idioma - e você carrega essa versão para 10 a 50 contas em um determinado GEO. Sem exclusividade, a plataforma vê o mesmo arquivo com os mesmos hashes, impressão digital de áudio e metadados – e vincula todas as contas. 360° Uniquizer resolve este problema: a partir de uma versão de idioma ele cria N arquivos exclusivos, cada um dos quais difere em todos os níveis de verificação. Fórmula: 1 original × 5 idiomas × 20 contas = 100 arquivos exclusivos via 360° Uniquizer.